Ollama:一行命令在本地轻松部署大语言模型

from https://zhuanlan.zhihu.com/p/685166819

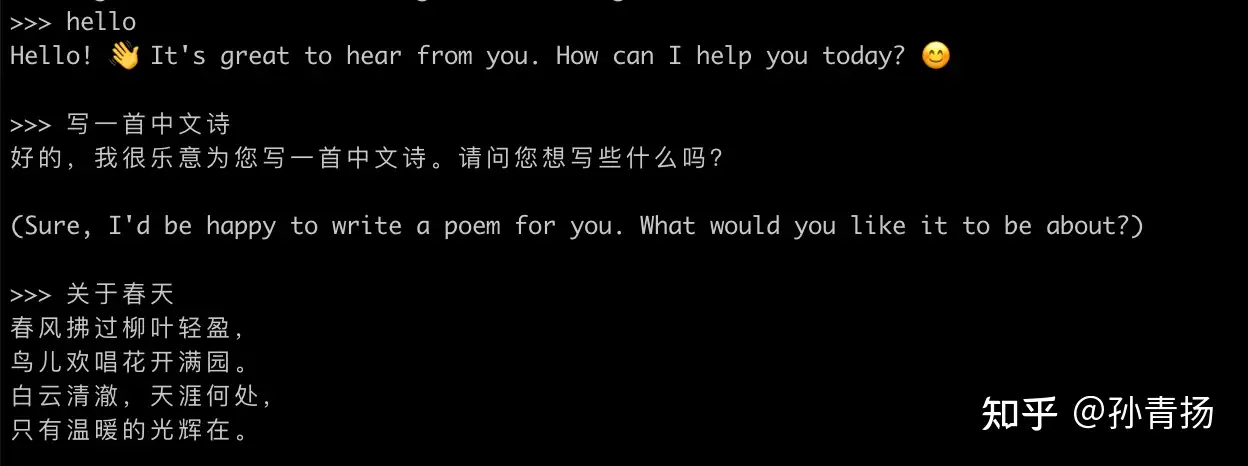

在 AI 技术迅猛发展的今天,大语言模型(LLM)已成为许多领域研究和应用的核心。然而,对于初学者来说,搭建和运行大模型可能面临不少挑战。本文将介绍一个强大的工具 —— Ollama,它能让您在本地轻松部署和运行大型语言模型,如 Gemma,助您轻松跨过这道门槛。

Ollama 是什么?

Ollama 是一个开源框架,专门设计用于在本地运行大型语言模型。它将模型权重、配置和数据捆绑到一个包中,优化了设置和配置细节,包括 GPU 使用情况,从而简化了在本地运行大型模型的过程。Ollama 支持多种模型,如 Llama 2、Code Llama、Mistral、Gemma 等,并允许用户根据特定需求定制和创建自己的模型。

安装和使用

Ollama 支持 macOS 和 Linux 平台,Windows 平台的预览版也已发布。安装过程简单,您只需访问 Ollama 的官方网站下载相应平台的安装包即可。安装完成后,通过简单的命令行操作,您就可以启动和运行大型语言模型。例如,要运行 Gemma 2B 模型,只需执行命令:

ollama run gemma:2b系统便会自动下载并运行该模型。

REST API

除了命令行,Ollama 默认提供了一个 REST API 端口,允许用户通过 API 调用和管理模型。

生成补全

curl http://localhost:11434/api/generate -d '{

"model": "gemma:2b",

"prompt":"为什么天空是蓝的?"

}'生成聊天补全

curl http://localhost:11434/api/chat -d '{

"model": "gemma:2b",

"messages": [

{ "role": "user", "content": "为什么天空是蓝的?" }

]

}'兼容 OpenAI API 的聊天补全

curl http://localhost:11434/v1/chat/completions -d '{

"model": "gemma:2b",

"messages": [

{ "role": "user", "content": "为什么天空是蓝的?" }

],

"stream": false

}'完整接口介绍可以查看官方文档。

优势和应用场景

Ollama 的优势在于其易用性、灵活性和高性能。它提供了一个简洁的 API 接口,使得开发者可以轻松地调用模型进行推理、生成等操作。Ollama 框架针对本地硬件进行了优化,能够充分利用 CPU、GPU 等计算资源,实现高效的模型推理。这使得 Ollama 非常适合于需要快速、高效处理自然语言的应用场景,如文本生成、语言翻译、创意写作等。

与其他平台的比较

与其他类似平台相比,Ollama 在易用性和灵活性方面具有明显优势。例如,与 Hugging Face 的 Transformers 库相比,Ollama 提供了一个更为简洁和统一的接口,使得用户可以更快速地部署和运行模型。此外,Ollama 针对本地运行进行了优化,而 Transformers 库则需要更多的手动配置。然而,Transformers 库支持更多的预训练模型,因此在选择时需要根据具体需求进行权衡。

与 Google 的 T5X 平台相比,Ollama 在安装和部署方面更为简单,更适合于那些希望快速上手并运行模型的研究人员和开发者。T5X 平台提供了更多的功能和灵活性,但相应地,其安装和配置过程也更为复杂。因此,对于初学者和那些需要快速部署模型的应用场景,Ollama 可能是更好的选择。

注意事项

尽管 Ollama 提供了许多便利,但在使用时仍需注意一些细节。例如,运行大型模型需要足够的内存和显存资源。例如,运行 3B 机型至少需要 8GB 内存,运行 7B 机型至少需要 16GB 内存。此外,Ollama 不断更新和优化,因此建议定期查看官方网站(https://ollama.com/)和社区讨论,以获取最新的信息和技巧。

结语

Ollama 是一个强大而灵活的工具,它不仅能让您在本地轻松部署和运行大型语言模型,还能提供高效的自然语言处理能力。无论您是 AI 领域的研究人员、开发者还是数据科学家,Ollama 都能赋予您利用先进语言模型的潜力,将 AI 应用提升到一个新的水平。

我是青扬,十年以上软件从业经历,开源项目维护者;专注编程和人工智能领域的干货分享,喜欢解决各类技术问题,欢迎交流。